Solo nove gigantesche aziende tecnologiche negli Stati Uniti e in Cina sono dietro la stragrande maggioranza dei progressi nell'intelligenza artificiale in tutto il mondo. Nel suo nuovo libro, The Big Nine: come i giganti della tecnologia e le loro macchine pensanti potrebbero deformare l'umanità (PublicAffairs, 5 marzo), Amy Webb immagina tre possibili futuri, che vanno dall'ottimistico all'apocalittico, che potrebbero derivare dalle azioni che intraprendiamo, o non intraprendiamo, per controllare lo sviluppo dell'intelligenza artificiale. e modellare il suo impatto globale. In questo estratto, pone una serie di difficili questioni etiche che gli umani che costruiscono l'A.I. i sistemi dovrebbero utilizzare per guidare il loro lavoro.

Le regole, l'algoritmo, con cui ogni cultura, società e nazione vive, e ha sempre vissuto, sono sempre state create da poche persone. Democrazia, comunismo, socialismo, religione, veganismo, nativismo, colonialismo: questi sono costrutti che abbiamo sviluppato nel corso della storia per aiutare a guidare le nostre decisioni. Anche nei casi migliori, non sono a prova di futuro. Le forze tecnologiche, sociali ed economiche intervengono sempre e ci inducono ad adattarci.

I Dieci Comandamenti costituiscono un algoritmo destinato a creare una società migliore per gli umani in vita più di 5.000 anni fa. Uno dei comandamenti è di prendersi un intero giorno di riposo alla settimana e di non fare alcun lavoro quel giorno. Nei tempi moderni, la maggior parte delle persone non lavora esattamente gli stessi giorni o le stesse ore di settimana in settimana, quindi sarebbe impossibile non infrangere la regola. Di conseguenza, le persone che seguono i Dieci Comandamenti come principio guida sono flessibili nella loro interpretazione, data la realtà di giornate lavorative più lunghe, allenamenti di calcio ed e-mail. Adattarsi va bene: funziona davvero bene per noi e per le nostre società, permettendoci di rimanere in carreggiata. Concordare una serie di linee guida di base ci consente di ottimizzare per noi stessi.

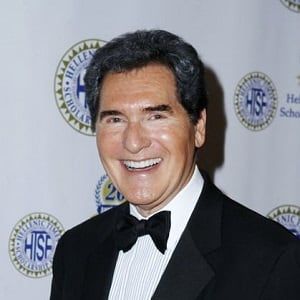

patrimonio netto di carly rose sonenclar

Non ci sarebbe modo di creare una serie di comandamenti per A.I. Non siamo riusciti a scrivere tutte le regole per ottimizzare correttamente per l'umanità, e questo perché mentre le macchine pensanti possono essere veloci e potenti, mancano di flessibilità. Non esiste un modo semplice per simulare le eccezioni o per provare a pensare in anticipo a ogni singola contingenza. Qualunque siano le regole scritte, ci sarebbe sempre una circostanza in futuro in cui alcune persone potrebbero voler interpretare le regole in modo diverso, o ignorarle completamente, o creare emendamenti per gestire una circostanza imprevista.

Sapendo che non possiamo assolutamente scrivere una serie di rigidi comandamenti da seguire, dovremmo, invece, focalizzare la nostra attenzione sugli umani che costruiscono i sistemi? Queste persone, le tribù di A.I., dovrebbero porsi domande scomode, a cominciare da:

anna-maria piedi verdi

- Qual è la nostra motivazione per l'A.I.? È allineato con i migliori interessi a lungo termine dell'umanità?

- Quali sono i nostri pregiudizi? Quali idee, esperienze e valori non siamo riusciti a includere nella nostra tribù? Chi abbiamo trascurato?

- Abbiamo incluso persone diverse da noi allo scopo di rendere il futuro di A.I. meglio o abbiamo semplicemente incluso la diversità nel nostro team per raggiungere determinate quote?

- Come possiamo garantire che il nostro comportamento sia inclusivo?

- In che modo le implicazioni tecnologiche, economiche e sociali dell'A.I. compreso da coloro che sono coinvolti nella sua creazione?

- Quali diritti fondamentali dovremmo avere per interrogare i set di dati, gli algoritmi e i processi utilizzati per prendere decisioni per nostro conto?

- Chi arriva a definire il valore della vita umana? Contro quale valore viene pesato?

- Quando e perché le tribù di A.I. sentono che è loro responsabilità affrontare le implicazioni sociali dell'A.I.?

- La leadership della nostra organizzazione e della nostra A.I. le tribù riflettono molti tipi diversi di persone?

- Che ruolo hanno coloro che commercializzano l'A.I. giocare nell'affrontare le implicazioni sociali dell'intelligenza artificiale?

- Se dovessimo continuare a confrontare A.I. al pensiero umano, o è meglio per noi classificarlo come qualcosa di diverso?

- Va bene costruire A.I. che riconosce e risponde alle emozioni umane?

- Va bene fare in modo che l'A.I. sistemi in grado di imitare le emozioni umane, soprattutto se imparano da noi in tempo reale?

- Qual è il punto accettabile in cui siamo tutti a posto con l'A.I. evolvere senza che gli umani siano direttamente coinvolti?

- In quali circostanze un'A.I. simulare e provare emozioni umane comuni? E il dolore, la perdita e la solitudine? Stiamo bene a causare quella sofferenza?

- Stiamo sviluppando l'A.I. cercare una comprensione più profonda di noi stessi? Possiamo usare l'A.I. aiutare l'umanità a vivere una vita più esaminata?

Ci sono nove grandi aziende tecnologiche - sei americane e tre cinesi - che sono in gran parte responsabili del futuro dell'intelligenza artificiale. Negli Stati Uniti sono Google, Microsoft, Amazon, Facebook, IBM e Apple ('G-MAFIA'). In Cina, è il BAT: Baidu, Alibaba e Tencent.

La G-MAFIA ha iniziato ad affrontare il problema dei principi guida attraverso vari gruppi di ricerca e studio. All'interno di Microsoft c'è un team chiamato FATE, per l'equità, la responsabilità, la trasparenza e l'etica nell'intelligenza artificiale. Sulla scia dello scandalo Cambridge Analytica, Facebook ha lanciato un team di etica che stava sviluppando software per assicurarsi che la sua A.I. sistemi evitati pregiudizi. (In particolare, Facebook non è arrivato al punto di creare un comitato etico incentrato sull'intelligenza artificiale). DeepMind ha creato un team di etica e società. IBM pubblica regolarmente su etica e A.I. Sulla scia di uno scandalo a Baidu - il motore di ricerca ha dato la priorità alle affermazioni mediche fuorvianti da un ospedale gestito dai militari, dove un trattamento ha provocato la morte di uno studente di 21 anni - il CEO di Baidu Robin Li ha ammesso che i dipendenti avevano fatto compromessi per il bene della crescita degli utili di Baidu e ha promesso di concentrarsi sull'etica in futuro.

florinka pesenti e dan abrams

The Big Nine produce studi etici e white paper, convoca esperti per discutere di etica e ospita panel sull'etica, ma questo sforzo non è abbastanza intrecciato con le operazioni quotidiane dei vari team che lavorano sull'intelligenza artificiale.

L'intelligenza artificiale dei Big Nine i sistemi accedono sempre più ai nostri dati del mondo reale per creare prodotti che mostrino valore commerciale. I cicli di sviluppo si stanno accelerando per tenere il passo con le aspettative degli investitori. Siamo stati disposti, anche se inconsapevoli, a partecipare a un futuro che viene creato frettolosamente e senza prima rispondere a tutte quelle domande. Come A.I. i sistemi avanzano e più della vita quotidiana viene automatizzata, meno controllo abbiamo effettivamente sulle decisioni che vengono prese su di noi e per noi.

Amy Webb apparirà al Inc. casa dei fondatori ad Austin l'11 marzo.